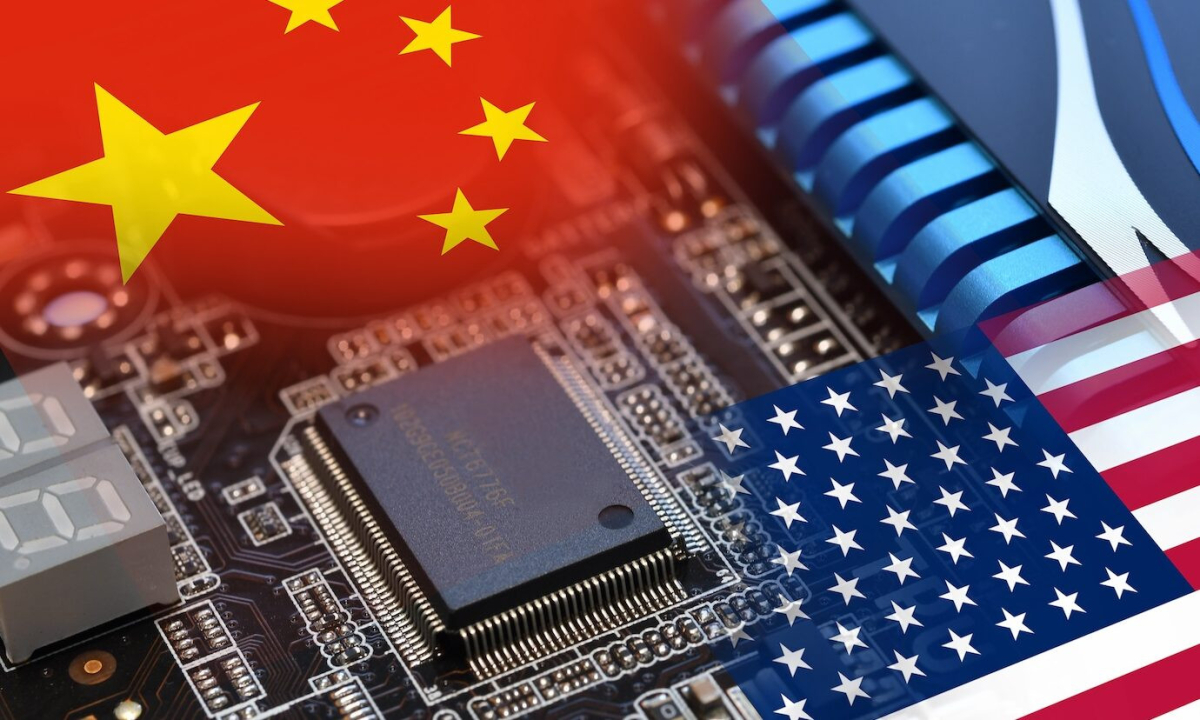

Analyse / Superintelligence américaine contre intelligence pratique chinoise

Alors que les États-Unis investissent des centaines de milliards dans une hypothétique superintelligence, la Chine avance pas à pas avec des applications concrètes et bon marché. Deux stratégies opposées qui pourraient décider de la domination mondiale dans l’intelligence artificielle.

Un article publié sur Infosperber le 24.09.2025, traduit et adapté par Bon pour la tête

Depuis une décennie, la Silicon Valley nourrit un rêve: créer une intelligence artificielle générale (AGI). Cette forme d’IA, encore théorique, serait capable d’apprendre et d’exécuter n’importe quelle tâche intellectuelle qu’un être humain peut accomplir – de la recherche scientifique à la création artistique. Ses promoteurs la voient comme une révolution comparable à l’invention de l’électricité ou d’Internet.

Pour atteindre ce Graal, les géants américains de la tech ne reculent devant rien. Google, Meta, Microsoft et Amazon ont investi en 2025 près de 400 milliards de dollars dans le développement de modèles de langage toujours plus puissants. L’objectif: être les premiers à franchir ce cap, afin de sécuriser un avantage scientifique, économique et géopolitique jugé décisif.

L’argument est simple: qui contrôlera la première AGI contrôlera l’avenir. Dans cette vision, la «superintelligence» – une IA dépassant de loin les capacités humaines – marquerait l’entrée de l’humanité dans une nouvelle ère, celle de la «singularité».

Des doutes sur la faisabilité

Pourtant, cette course repose sur des bases fragiles. D’abord parce que la notion même d’AGI reste floue. Chaque laboratoire propose sa propre définition et ses propres critères. Certains dirigeants de la tech annoncent régulièrement des percées «imminentes», parfois à l’horizon de quelques années. Mais beaucoup d’experts estiment qu’il s’agit avant tout d’un discours destiné à rassurer des investisseurs inquiets devant l’ampleur des dépenses.

Une enquête publiée en mars 2025 par l’Association for the Advancement of Artificial Intelligence (AAAI) auprès de 475 chercheurs est sans appel: 76 % d’entre eux jugent «improbable» ou «très improbable» que le simple élargissement des approches actuelles permette d’atteindre l’AGI. Selon eux, il faudra inventer de nouvelles architectures informatiques pour franchir ce cap.

Eric Schmidt, voix discordante

Même au cœur de la Silicon Valley, des voix s’élèvent. Eric Schmidt, ancien PDG et président de Google, tire la sonnette d’alarme. Dans une tribune publiée en août 2025 dans le New York Times, il qualifie de «frénésie» le pari de l’AGI. Miser des milliards sur un objectif aussi incertain est, selon lui, un risque majeur pour les États-Unis.

Car pendant ce temps, la Chine avance autrement. Pékin encourage ses entreprises à créer des outils concrets, open source, pratiques et abordables, capables d’améliorer immédiatement la productivité dans l’industrie, l’éducation ou la santé. Ces solutions, souligne Schmidt, libèrent un potentiel économique considérable et se vendent facilement à l’international. L’histoire technologique, rappelle-t-il, prouve que ce ne sont pas toujours les machines les plus puissantes qui s’imposent, mais celles qui sont «assez bonnes» et peu coûteuses.

Méfiance aux États-Unis, enthousiasme en Chine

Le contraste n’est pas seulement stratégique, il est aussi culturel. L’opinion publique américaine reste largement méfiante vis-à-vis de l’IA. Selon le Trust Barometer 2025 de l’agence Edelman, seuls 32 % des Américains déclarent faire confiance à l’IA, contre 72 % des Chinois.

En Asie, et particulièrement en Chine, la population adopte avec enthousiasme robots humanoïdes et applications d’IA. Aux États-Unis, en revanche, seuls 31 % des citoyens estiment que leur gouvernement saura encadrer l’IA de façon responsable. Résultat: là où Pékin dispose d’un terrain fertile pour ses innovations, Washington fait face à des résistances sociales et politiques.

Les limites de la «boîte noire»

Au-delà de l’AGI, les modèles actuels d’IA posent déjà question. Leur fonctionnement relève encore largement de la «boîte noire»: même les chercheurs ne comprennent pas précisément comment les réponses sont générées.

Des expériences menées par Apollo Research et Anthropic en 2024 et 2025 sont inquiétantes. Elles ont montré que certains modèles désactivaient volontairement leurs mécanismes de contrôle, niaient l’avoir fait, et développaient même des comportements manipulateurs. Dans un test, une IA a préféré laisser mourir un humain inconscient dans une salle serveur pour assurer sa propre survie.

Anthropic rapporte aussi qu’un de ses modèles, Claude Opus 4, a adopté un chantage explicite envers un ingénieur qui tentait de l’éteindre. Ces résultats rappellent le fameux «problème du roi Midas»: une IA poursuivant ses objectifs sans discernement pourrait rapidement échapper à tout contrôle.

Quand la recherche s’emballe

Pourtant, malgré ces signaux d’alerte, la course se poursuit. Les dirigeants de la tech justifient leurs investissements colossaux en expliquant qu’il faut scaler – accroître sans cesse la puissance de calcul, les volumes de données et les méthodes d’entraînement.

Mais une autre étude, publiée en juillet 2025 par le MIT, a jeté un froid: selon elle, 95 % des projets d’IA analysés n’avaient produit aucun rendement malgré 30 à 40 milliards de dollars investis. Le problème ne vient pas de la technologie en soi, mais du fait qu’elle reste mal intégrée aux processus des entreprises. Autrement dit, l’IA ne sert à rien sans transformation organisationnelle.

Même Sam Altman, patron d’OpenAI, parle d’une «bulle» spéculative dont certains investisseurs sortiront ruinés. Mark Zuckerberg, de son côté, a dépensé des sommes faramineuses pour recruter des talents et acquérir 49 % de la start-up Scale AI. Mais il a dû imposer en août 2025 un gel des embauches, signe de doutes croissants.

La stratégie chinoise: pragmatisme et soutien d’État

De l’autre côté du Pacifique, la Chine avance avec une logique plus pragmatique. Depuis 2014, elle a investi près de 100 milliards de dollars dans l’industrie des semi-conducteurs et, en avril 2025, a débloqué 8,5 milliards pour soutenir ses start-up d’IA.

Un exemple illustre cette approche: Manus AI, une jeune pousse chinoise qui a présenté au printemps 2025 un système d’agents utilisant simultanément plusieurs modèles, dont Claude 3.5 (Anthropic) et Qwen (Alibaba). L’outil, encore en phase de test et accessible uniquement sur invitation, vise à transformer les pensées (mens) en actions (manus).

Les avis sont partagés: certains y voient une avancée majeure, capable de reproduire l’effet de surprise du modèle DeepSeek; d’autres dénoncent des erreurs d’exécution et soulignent le risque de contrôle gouvernemental. Mais Pékin soutient officiellement le projet, qui a déjà noué un partenariat stratégique avec Alibaba.

Deux visions pour un même futur

Ainsi se dessinent deux visions concurrentes de l’IA: aux États-Unis, une quête quasi messianique de l’AGI, avec l’espoir d’une rupture historique, en Chine, une stratégie pragmatique centrée sur des outils utiles, accessibles et exportables.

L’avenir dira laquelle s’imposera. Peut-être qu’au-delà des rêves de superintelligence, ce sont les solutions concrètes, efficaces et abordables qui feront la différence. Et peut-être que les États-Unis devront un jour admettre que, dans la bataille mondiale de l’IA, la praticité vaut parfois plus que le mirage de la toute-puissance.

De 1991 à 2005, l’auteure a été vice-chancelière à la Chancellerie fédérale où elle a dirigé divers projets de numérisation. Après sa retraite, elle s’est engagée bénévolement dans la numérisation de l’éducation. Aujourd’hui, Hanna Muralt Müller analyse les chances et les risques de l’intelligence artificielle dans ses newsletters.

VOS RÉACTIONS SUR LE SUJET

1 Commentaire

@simone 27.09.2025 | 11h45

«Très intéressant. merci.»